马上注册,让你轻松玩转程序园

您需要 登录 才可以下载或查看,没有账号?立即注册

x

1、寻找替代方案几个月前,我开始尝试本地运行的人工智能编码模型。

我的目标很明确:

输入:Gemma 4 + Ollama。

Gemma 4是Google最新的开放模型。Ollama是在本地运行大型语言模型的工具。

它们的组合改变了我的开发流程。

2、为什么选择Gemma 4?

Gemma 4有几个关键优势:

1.完全本地运行

你的代码永远不需要离开你的机器。隐私得到保证。

2.免费使用

没有API调用成本。一旦模型下载,你可以无限使用。

3.快速响应

本地模型意味着零网络延迟。

4.完全控制

你选择何时更新模型或更改配置。

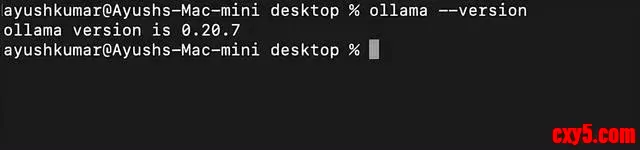

3、入门设置步骤1:安装Ollama

首先,安装Ollama工具:

curl-fsSL https://ollama.com/install.sh|sh这将在你的机器上设置Ollama。

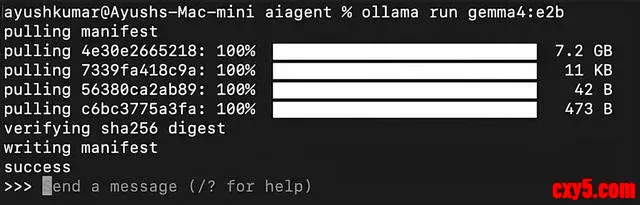

步骤2:下载Gemma 4

安装Ollama后,获取Gemma 4模型:

ollama pull gemma:2b或者对于更强大的版本:

ollama pull gemma:7b根据你的硬件选择。2b版本可以在大多数笔记本电脑上运行。7b版本需要更多资源。

步骤3:测试模型

运行一下命令确保它工作:

ollama run gemma:2b现在你可以和它聊天了。

4、构建你的编码代理现在有趣的部分开始了。

你需要的不只是一个聊天机器人。你需要一个可以帮你编码的代理。

这是我的设置:

工具1:代码编辑器

使用VS Code或你喜欢的编辑器。

工具2:Ollama后端

Gemma 4通过Ollama运行。

工具3:Claude Code(可选)

如果你想增强功能,Claude Code可以作为补充。

5、我的实际工作流程这是我的设置:

1.分析需求

我告诉Gemma我需要什么。例如:

"创建一个Express服务器,监听3000端口,返回Hello World"2.生成代码

Gemma生成代码。我检查并修改。

3.自动补全

对于简单任务,Copilot风格的补全仍然有效。

4.调试帮助

当事情不工作,我让Gemma分析错误。

6、性能对比让我比较一下我的设置:

方面

| 云端AI

| 本地Gemma

| 延迟

| 2-5秒

| 0.5-1秒

| 隐私

| 差

| 优

| 控制

| 有限

| 完全

| 成本

| 订阅/月

| 一次性

|

本地设置在我的日常任务上甚至更快。

7、处理复杂任务对于复杂任务,我使用分层方法:

简单任务:直接使用Gemma

函数创建

简单调试

代码补全

复杂任务:云端AI

架构决策

大规模重构

高级推理

这给了我两全其美。

8、实际示例让我展示一个真实的例子。

任务:创建一个Express服务器

我给Gemma的提示:

创建一个简单的Express服务器,监听3000端口。当访问根路径时,返回"Hello World from the Express Server!"Gemma的响应(经过本地运行后):

const express=require('express');const app=express();const port=3000;app.get('/',(req,res)=>{res.send('Hello World from the Express Server!');});app.listen(port,()=>{console.log(`Express server is running at http://localhost {port}`);});9、部署它代码很直接: {port}`);});9、部署它代码很直接:

初始化项目:

npm init-ynpm install express保存文件:

将代码保存为server.js。

运行服务器:

node server.js测试服务器:

打开你的浏览器或使用curl访问服务器:

导航到:http://localhost:3000

你会看到响应:Hello World from the Express Server!

10、结束语完全替换Codex?还不是。

但替换工作流程的重要部分?绝对是。

这个实验显示的很简单:

你不再需要完全依赖云端人工智能来构建真正的软件。

使用Gemma 4和Ollama,你现在可以:

本地运行人工智能模型

构建和理解代码

创建真正的开发工作流程

保持对环境的完全控制

所有这一切都不需要向外部API发送一行代码。

|